Bajada: AWS lanzó la disponibilidad general de Interconnect – multicloud con Google Cloud como primer socio, prometiendo enlaces privados, redundancia integrada y provisión en minutos. Para equipos de plataforma y redes, la novedad no es solo conectividad: cambia cómo se diseña la resiliencia, el enrutamiento y el costo operativo entre nubes.

Introducción

La conectividad entre nubes públicas dejó de ser un caso excepcional. En muchos entornos empresariales ya conviven aplicaciones en AWS, analítica en Google Cloud, servicios de seguridad en otro proveedor y componentes heredados en datacenter. El problema es que ese modelo multicloud suele apoyarse en arquitecturas artesanales: túneles VPN, proveedores de interconexión, ruteo BGP administrado por terceros y varias capas de coordinación operacional.

Con la disponibilidad general de AWS Interconnect – multicloud, AWS plantea una alternativa administrada para conectar VPCs de AWS con otras nubes privadas sin pasar por Internet pública. El anuncio parece incremental, pero tiene implicancias concretas en tiempos de provisión, topologías de red, observabilidad y control de costos para equipos DevOps, SRE y de infraestructura.

Qué ocurrió

AWS anunció la GA de Interconnect – multicloud el 14 de abril de 2026. El servicio arranca con Google Cloud como primer partner, y AWS anticipa soporte para Microsoft Azure y Oracle Cloud Infrastructure más adelante en 2026. En paralelo, AWS publicó una especificación abierta en GitHub para que otros proveedores adopten el modelo de interoperabilidad.

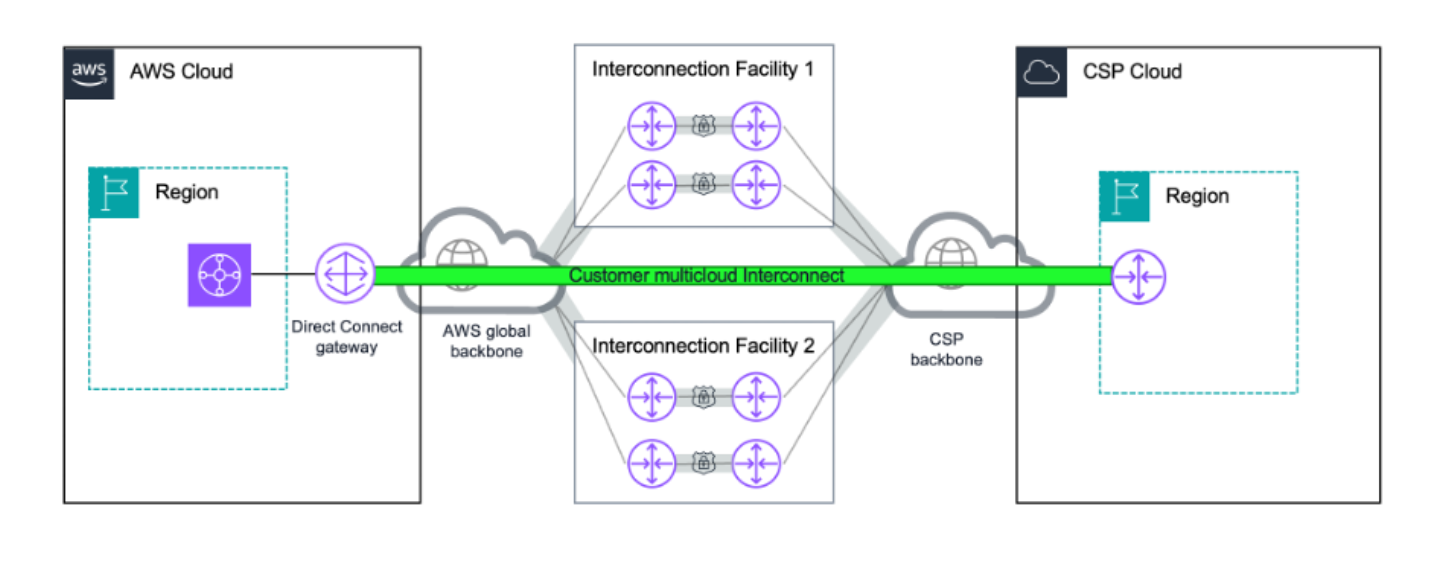

Según AWS, la propuesta es ofrecer conectividad privada y administrada de capa 3 entre Amazon VPC y redes de otros CSP, con aprovisionamiento en minutos desde consola, CLI o API. El servicio también se integra con componentes ya habituales en arquitecturas enterprise, como Direct Connect Gateway, Transit Gateway y Cloud WAN.

Impacto para DevOps / Infraestructura / Cloud / Seguridad

El impacto más inmediato es operativo: reduce la fricción para habilitar redes multicloud sin abrir un proyecto de semanas entre networking, seguridad y compras. Para equipos de plataforma, esto acelera escenarios como DR cruzado entre nubes, migraciones graduales de aplicaciones o exposición de servicios entre dominios cloud distintos.

En seguridad, la principal ventaja es que el tráfico puede mantenerse en backbones privados de los proveedores, en lugar de depender de Internet pública. AWS destaca cifrado MACsec en los enlaces físicos entre routers en la interconexión inicial y una arquitectura con redundancia múltiple. Eso no elimina la necesidad de controles de cifrado de extremo a extremo y segmentación por políticas, pero sí mejora la postura base frente a una malla de VPNs heterogéneas.

Para SRE, la estandarización simplifica parte del troubleshooting: menos piezas manuales suele significar menos puntos opacos durante incidentes. A la vez, aparecen nuevas dependencias de diseño. Por ejemplo, si se conecta Interconnect con Cloud WAN, la topología global puede empujar el enlace a tiers de precio más altos según la región origen del tráfico, lo que exige revisar arquitectura y FinOps de forma conjunta.

Detalles técnicos

AWS describe tres ejes técnicos clave. Primero, provisión simplificada: seleccionar proveedor, región remota y ancho de banda, luego activar la contraparte en el otro cloud. Segundo, resiliencia integrada: el servicio incorpora redundancia sin que el cliente tenga que diseñar manualmente múltiples circuitos físicos. Tercero, modelo administrado de operación: AWS y el partner cloud se encargan de la infraestructura de interconexión y su soporte.

Del lado de Google Cloud, la documentación de Partner Cross-Cloud Interconnect para AWS confirma varias de estas propiedades: creación en minutos, granularidad de velocidades desde 1 Gbps a 100 Gbps, y redundancia incluida en el servicio, en contraste con el modelo clásico donde el cliente debía diseñar y mantener duplicación por su cuenta.

Otro cambio relevante está en precios. AWS define un esquema horario por interconnect según ancho de banda y tier geográfico, sin cargo por GB transferido en el propio interconnect. También informa una opción de 500 Mbps local gratis por región a partir de mayo. Sin embargo, la lectura fina es obligatoria: el tier final puede subir cuando se combinan interconnects con topologías globales de Cloud WAN, lo que altera el costo mensual de manera significativa aunque el enlace físico esté en una región “local”.

Por último, en observabilidad, AWS menciona integración con CloudWatch y Network Synthetic Monitor para métricas de latencia, pérdida de paquetes y utilización. Para equipos de operaciones, esto habilita un patrón recomendable: declarar SLOs específicos para enlaces intercloud y no tratarlos como simple “transporte transparente”.

Qué deberían hacer los administradores o equipos técnicos

1) Identificar flujos candidatos. No todo tráfico entre nubes necesita un enlace dedicado. Prioricen cargas sensibles a latencia, replicación de datos crítica, integración de control planes o rutas de contingencia donde VPN tradicional hoy sea un cuello de botella.

2) Revisar el diseño de ruteo antes de aprovisionar. Definan si el interconnect irá contra una VPC puntual, Transit Gateway o Cloud WAN. Esa decisión afecta complejidad, blast radius y costos.

3) Modelar costos por topología, no por enlace aislado. Simulen escenarios regionales y crecimiento de tráfico. En particular, validen el tier efectivo si hay core global multi-región.

4) Endurecer seguridad por capas. Traten la conectividad privada como base, no como control único. Mantengan cifrado de aplicación cuando corresponda, segmentación estricta, IAM mínimo privilegio y auditoría de rutas anunciadas.

5) Definir observabilidad desde el día cero. Instrumenten umbrales para latencia/pérdida, alertas de saturación y runbooks específicos para degradación de enlaces intercloud.

6) Ejecutar una prueba de falla real. Antes de declarar “listo para producción”, validen con chaos drills o conmutación controlada que la redundancia integrada realmente cumple objetivos de continuidad.

Conclusión

La GA de AWS Interconnect – multicloud es más que un anuncio de networking: reduce barreras prácticas para operar arquitecturas multicloud con menor fricción y mayor previsibilidad. Su valor real no está en “conectar dos nubes” —eso ya era posible— sino en convertir una integración históricamente artesanal en un servicio con operación más estandarizada.

Para equipos DevOps e infraestructura, la oportunidad está en usar esta simplificación para mejorar resiliencia y velocidad de entrega sin perder disciplina técnica. La advertencia también es clara: una conectividad más fácil puede amplificar errores de diseño si no se gobiernan rutas, costos y dependencias operativas desde el inicio.

Fuentes

- AWS announces general availability of AWS Interconnect – multicloud

- AWS Interconnect is now generally available (AWS News Blog)

- Partner Cross-Cloud Interconnect for AWS overview (Google Cloud)