Introducción

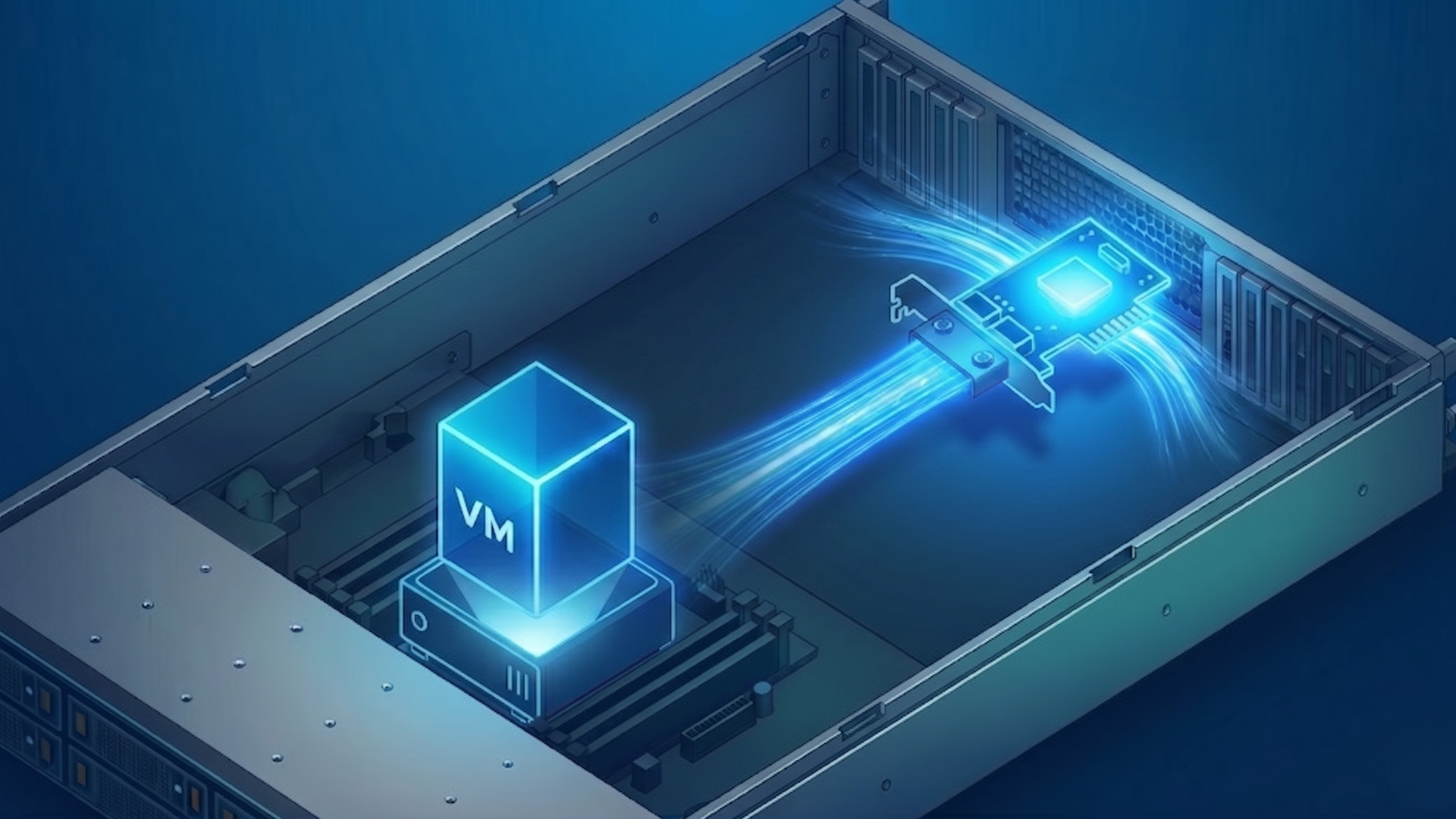

En un entorno de producción con vSphere, elegir entre rendimiento puro o virtualización avanzada ya no es una decisión binaria. Tradicionalmente, si se habilitaba DirectPath I/O (ahora llamado Fixed DirectPath) para passthrough de dispositivos PCIe como GPUs o tarjetas de red de 100 Gbps, se perdían funcionalidades críticas: vMotion, Suspend/Resume, Live Patch, y DRS. El costo operativo era alto: cualquier mantenimiento requería downtime y reconfiguración manual de VMs.

Con la llegada de Enhanced DirectPath en vSphere 8, VMware eliminó ese trade-off. Ahora es posible asignar dispositivos PCIe directamente a máquinas virtuales con rendimiento cercano al nativo, mientras se conservan todas las capacidades de virtualización. Esto es especialmente relevante para cargas de trabajo que demandan baja latencia y aceleración hardware, como inferencia de IA, procesamiento de streaming en tiempo real o bases de datos de alto throughput.

Qué ocurrió

En abril de 2026, VMware anunció Enhanced DirectPath como parte de vSphere 8 Update 2 y VMware Cloud Foundation 8.x. La novedad no fue solo el rendimiento —ya cubierto por Fixed DirectPath—, sino la integración con el stack de virtualización:

- vMotion: migración en vivo de VMs con dispositivos passthrough asignados.

- DRS: balanceo automático basado en características del hardware (ej: «GPU NVIDIA A100 con 40 GB HBM2»).

- HA: reinicio automático en otro host si falla el primario.

- Live Patch: aplicación de parches sin interrumpir la VM.

- Suspend/Resume: suspensión y reanudación de VMs sin perder el estado del dispositivo.

Esto se logró mediante una nueva API de hardware-backed virtual devices, que abstrae el dispositivo físico y expone una interfaz virtual compatible con el stack de vSphere. Según el blog oficial de VMware Cloud Foundation:

> «Enhanced DirectPath no es solo para GPUs. Funciona con NICs de alto rendimiento (como las Mellanox ConnectX-6), FPGAs (Intel QAT) y aceleradores criptográficos (AWS Nitro Cards) sin perder vMotion.»

Impacto para DevOps / Infraestructura / Cloud / Seguridad

Para equipos de DevOps e Infraestructura

- Reducción de downtime en entornos críticos:

– Después: Con Enhanced DirectPath, el mismo mantenimiento se realiza con vMotion automático (si está configurado HA) o con Live Patch, sin interrupción visible para el usuario final. Según datos internos de VMware, en entornos con más de 50 VMs con aceleradores, el tiempo de mantenimiento se redujo de 45 minutos a 5 minutos por host.

- Simplificación de la infraestructura:

- Costos operativos:

Para equipos de Seguridad

- Menor exposición a riesgos:

– Enhanced DirectPath encapsula el acceso al hardware mediante la nueva API, reduciendo el riesgo de exploits directos al dispositivo. Además, al soportar Live Patch, los parches de seguridad del hipervisor se aplican sin reiniciar la VM.

- Compliance:

Para equipos de Cloud

- Movilidad de cargas de trabajo:

Detalles técnicos

Comparación entre passthrough métodos

| **Característica** | **Fixed DirectPath** | **Dynamic DirectPath** | **Enhanced DirectPath** |

|---|---|---|---|

| **Rendimiento** | Nativo (1:1) | Nativo (1:1) | Nativo (1:1) |

| **vMotion** | ❌ No | ❌ No | ✅ Sí |

| **DRS** | ❌ No | ✅ Sí (selección por attrs) | ✅ Sí (selección por attrs) |

| **HA** | ❌ No | ❌ No | ✅ Sí |

| **Live Patch** | ❌ No | ❌ No | ✅ Sí |

| **Suspend/Resume** | ❌ No | ❌ No | ✅ Sí |

| **Dispositivos soportados** | PFs y VFs | PFs y VFs | PFs, VFs, NICs, FPGAs, GPUs |

| **Compartición de dispositivo** | ❌ No (PF) / ✅ (VF) | ✅ (VF) | ✅ (VF y PF en algunos casos) |

| **Migración entre hosts** | ❌ Manual (editar config) | ✅ (DRS) / ❌ vMotion | ✅ (vMotion + DRS) |

Enhanced DirectPath introduce dos componentes clave:

- API de Virtual Devices:

vGPU, vNIC, vFPGA) que el hipervisor gestiona como un dispositivo virtual estándar.

– El hardware físico se asigna dinámicamente mediante Intel VT-d o AMD-Vi (IOMMU), pero con un wrapper de virtualización que permite operaciones como vMotion.

- Controlador de Dispositivo Virtual (VDC):

– El VDC en Host A libera el dispositivo.

– El VDC en Host B reclama el dispositivo y restaura el estado (ej: contexto de la GPU).

Dispositivos soportados (versión 8.0 Update 2)

VMware mantiene una lista actualizada en el Broadcom Compatibility Guide (BCG). A mayo de 2026, los dispositivos certificados incluyen:

- GPUs:

– AMD: Instinct MI300X.

- NICs de alto rendimiento:

– Intel: Ethernet 800 Series (E810-C).

- Aceleradores:

– Crypto: AWS Nitro Cards (para entornos en AWS Outposts).

Nota: No todos los dispositivos soportan todas las funciones. Por ejemplo, las GPUs NVIDIA requieren el driver vGPU 16.0 o superior para soportar vMotion.Requisitos mínimos

- vSphere: 8.0 Update 2 o superior.

- VMware Cloud Foundation: 8.x con vCenter 8.0 Update 2.

- Hardware:

– IOMMU habilitado en BIOS/UEFI.

– Firmware actualizado (ej: BIOS de servidor Dell PowerEdge R750 debe estar en versión 1.8.0 o superior para ConnectX-6 DX).

Qué deberían hacer los administradores y equipos técnicos

Paso 1: Verificar compatibilidad del hardware

Ejecutar el siguiente comando en el host ESXi para confirmar soporte de IOMMU:

esxcli hardware pci list | grep -i iommuSi el resultado incluye Intel VT-d o AMD-Vi, el hardware es compatible. De lo contrario, actualizar la BIOS y probar nuevamente.

Paso 2: Actualizar vSphere y VMware Cloud Foundation

- Actualizar a vSphere 8.0 Update 2:

esxcli software vib update -d /tmp/VMware-ESXi-8.0U2-XXXXX-depot.zip

- Actualizar vCenter a 8.0 Update 2:

vcvsa upgrade --accept-eula /tmp/vcsa-8.0.2-XXXXX.iso

- Actualizar VMware Cloud Foundation (si aplica):

vcf upgrade --accept-eula --bundle /tmp/vcf-bundle-8.0.2-XXXXX.zip

Paso 3: Configurar Enhanced DirectPath en la VM

- Habilitar IOMMU en ESXi:

/etc/vmware/esx.conf y agregar:

/adv/pciPassthru/allowP2P = "TRUE"

/adv/pciPassthru/allowRdma = "TRUE"

Reiniciar el host.

- Asignar el dispositivo a la VM:

– Seleccionar el dispositivo (ej: «NVIDIA A100 40GB [0000:81:00.0]»).

– Habilitar vMotion en la configuración de la VM:

vmx.allowPassthruDevicePassthru = "TRUE"

vmx.pciPassthru.policy = "enhanced"

- Verificar la asignación:

vmkchdev -l | grep -i nvidia

Debería listar el dispositivo con estado active.

Paso 4: Validar vMotion con dispositivo passthrough

- Iniciar una migración manual en vCenter:

– Seleccionar Change compute resource only (para probar vMotion sin almacenamiento).

– Confirmar que la VM migra sin errores y el dispositivo sigue accesible:

nvidia-smi -L # En la VM, verificar que la GPU sigue visible

- Probar HA:

– Verificar que la VM se reinicie en otro host y el dispositivo esté disponible.

Paso 5: Monitoreo y troubleshooting

- Logs de Enhanced DirectPath:

tail -f /var/log/vmkernel.log | grep -i "enhancedPassthru"

Buscar errores como:

– Failed to reserve device for passthrough: Indica conflicto con otro dispositivo.

– Enhanced passthrough not supported: El hardware no cumple requisitos.

- Métricas de rendimiento:

– Filtrar por Passthrough Device Latency para verificar que no haya picos (>1ms puede indicar problemas de IOMMU).

Conclusión

Enhanced DirectPath marca un punto de inflexión en la virtualización de cargas de trabajo de alto rendimiento. Ya no es necesario elegir entre rendimiento nativo y operaciones avanzadas como vMotion o HA. Para equipos de DevOps e Infraestructura, esto significa:

- Menor downtime en entornos críticos.

- Automatización completa (DRS, HA) para dispositivos passthrough.

- Simplificación de la gestión al unificar el modelo de virtualización.

La adopción requiere actualizar a vSphere 8.0 Update 2 y verificar compatibilidad con el Broadcom Compatibility Guide, pero los beneficios en operatividad y continuidad superan ampliamente el esfuerzo. Como indica Nick, Product Manager de ESX:

> «Si tu carga de trabajo necesita hardware cercano al nativo, Enhanced DirectPath es la opción. Si no, sigue con paravirtual (VMXNET3, vGPU no passthrough).»

Fuentes

- Why Enhanced DirectPath Wins for High-Performance Apps

- Broadcom Compatibility Guide (BCG) – Enhanced DirectPath

- VMware vSphere 8.0 Update 2 Release Notes