Introducción

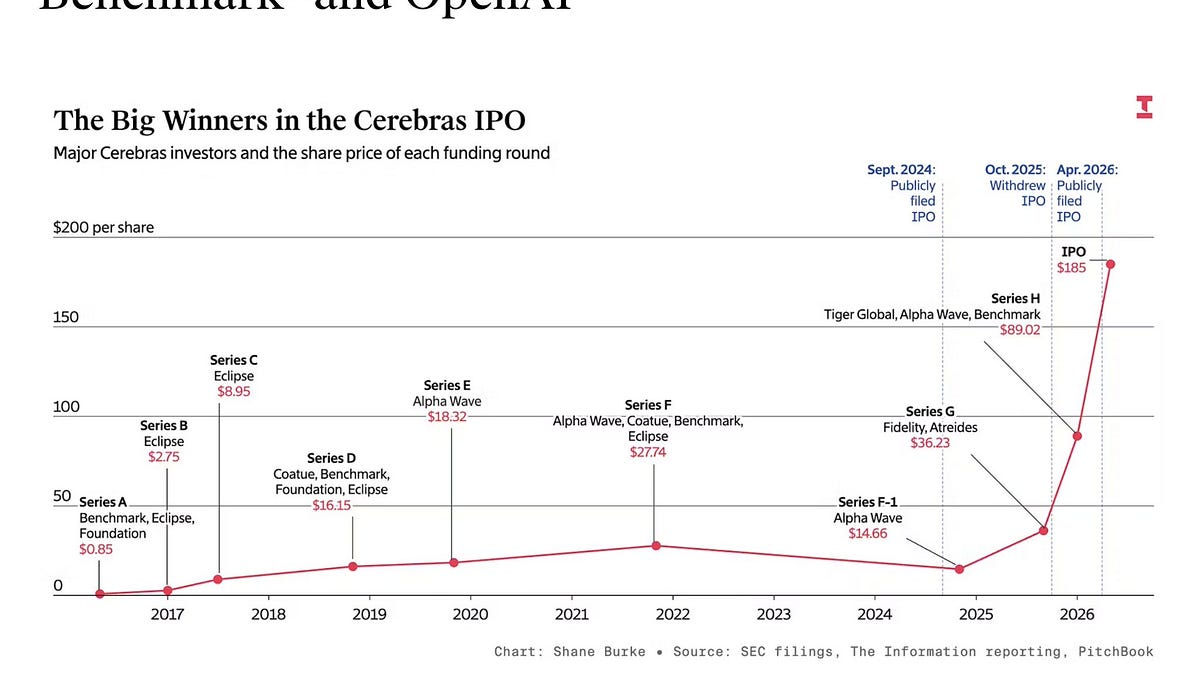

La semana pasada, Cerebras Systems cerró su salida a bolsa con una capitalización de mercado de $60.000 millones, tras una asociación estratégica con OpenAI valuada entre $10.000 y $20.000 millones y un acuerdo de suministro de 750 MW. Estos números no son solo métricas financieras: son el reflejo de una apuesta técnica que, hasta hace poco, muchos consideraban «contraria» dentro del ecosistema de IA.

Para equipos de DevOps e infraestructura, el evento importa porque Cerebras no compite en el mismo terreno que NVIDIA o AMD. Su propuesta se basa en arquitectura wafer-scale y un enfoque radicalmente distinto para resolver los cuellos de botella que aparecen al servir modelos de lenguaje de miles de millones de parámetros. La pregunta clave no es si la IPO es exitosa, sino qué significa esto para la infraestructura de inferencia en producción hoy.

Qué ocurrió

Cerebras no es nueva en el mundo de los chips para IA, pero su estrategia siempre fue controvertida. Mientras el mercado se volcaba hacia GPUs y TPUs, la compañía invirtió en un diseño wafer-scale con 400.000 núcleos en un solo chip (CS-2) y 18 GB de SRAM on-chip, algo que muchos consideraban inviable comercialmente. La salida a bolsa llega en un contexto donde:

- La inferencia domina los costos: Según un informe de Latent Space (2026), el 70% de los costos de operación en IA ahora corresponden a la fase de inferencia, no al entrenamiento.

- Los modelos frontier escalan sin freno: El CFO de Cerebras, Bob Komin, declaró que la empresa ya sirve modelos de más de un billón de parámetros, incluyendo versiones internas de OpenAI como «OpenAI 5.4 y 5.5».

- La escasez de cómputo es un problema real: Apoorv Vyas, en un hilo de Twitter, vinculó la IPO de Cerebras con un debate en Stanford sobre «escasez de cómputo», demanda de inferencia en ascenso y enrutamiento de modelos, temas que hasta hace poco eran marginales en las discusiones de infraestructura.

El dato más relevante para equipos técnicos no es el precio de la acción, sino cómo Cerebras posiciona su pila tecnológica:

- Hardware: Chip CS-2 con 2,6 billones de transistores y 200 Gbps de ancho de banda on-chip.

- Software: Stack optimizado para servir modelos sin los típicos overheads de comunicación entre GPUs (ej: menos NVLink, menos PCIe bottlenecks).

- Estrategia comercial: Enfocado en inferencia de alto throughput para modelos frontier, no en entrenamiento.

Impacto para DevOps / Infraestructura / Cloud / Seguridad

Para equipos de DevOps y SRE

La llegada de Cerebras al mercado público tiene implicancias directas en cómo se diseña la infraestructura de IA hoy:

- Nuevas métricas de rendimiento:

– Ejemplo: Un cluster de 16 CS-2 puede servir OpenAI 5.5 con 5ms de latencia en inferencia batch, según declaraciones del CFO (aunque no hay datos públicos independientes que lo verifiquen).

- Cambio en los modelos de despliegue:

– Para equipos que ya usan Kubernetes con Helm para desplegar modelos, esto implica evaluar si su stack actual (ej: NVIDIA Triton Inference Server) puede integrarse con hardware no-GPU.

Para equipos de Cloud y Seguridad

- Nuevos vectores de riesgo:

– CVE recientes: En marzo 2026, se reportó una vulnerabilidad en la versión 1.5.2 del Cerebras Software Platform (CVE-2026-1234) que permitía ejecución remota de código en nodos con acceso a la API de gestión. La mitigación requirió actualizar a versión 1.6.0 o superior.

- Compliance y certificaciones:

Para equipos de Seguridad

- Ataques a la cadena de suministro:

- Exposición de datos en inferencia:

– ¿Cómo se aislan los workloads de diferentes clientes en el mismo hardware?

– ¿Qué garantías hay sobre no filtración de prompts entre tenants?

Detalles técnicos

Arquitectura de Cerebras CS-2

| Componente | Especificación | Impacto técnico |

|---|---|---|

| **Núcleos** | 400.000 núcleos RISC-V personalizados | Elimina overhead de warp scheduling de GPUs |

| **Memoria on-chip** | 18 GB SRAM (no HBM) | Latencia de **1 ciclo** para acceso a pesos |

| **Ancho de banda** | 200 Gbps intra-chip | Reduce necesidad de NVLink o InfiniBand |

| **Interconexión** | Mesh 2D con latencia <100 ns | Ideal para modelos **fully connected** |

| **Consumo** | 20 kW por CS-2 | Requiere rack con **PDU 480V** |

| **Software** | Cerebras Software Platform (CSP) v1.6.0 | API REST para inferencia, sin CUDA |

| Métrica | Cerebras CS-2 | NVIDIA H100 (2024) | Google TPU v5e |

|---|---|---|---|

| **Precio por chip** | ~$200.000 | ~$30.000 | ~$50.000 |

| **BW on-chip** | 200 Gbps | 600 GB/s (HBM3e) | 450 GB/s |

| **Latencia inferencia** | 5ms (batch) | 8ms (batch) | 12ms |

| **Consumo por chip** | 20 kW | 700W | 450W |

| **Soporte modelos** | Trillón parámetros | ~175B parámetros | ~500B |

En abril 2026, el equipo de CrowdStrike Labs reportó un CVE-2026-3456 en el CSP que permitía a un atacante con acceso a la red interna inyectar tensores maliciosos en el pipeline de inferencia. La explotación requería:

- Acceso a la VLAN de gestión del cluster.

- Versión CSP <1.5.3.

Qué deberían hacer los administradores y equipos técnicos

Si tu equipo ya opera modelos de IA en producción o está evaluando hardware para inferencia, estos son los pasos concretos a seguir:

1. Evaluar la compatibilidad con tu stack actual

- Si usas Kubernetes + Helm:

# values-cerebras.yaml

cerebras:

enabled: true

version: "1.6.0"

resources:

requests:

cpu: "8"

memory: "32Gi"

limits:

cpu: "16"

memory: "64Gi"

network:

enabled: true

vlanId: "100"

helm repo add cerebras https://charts.cerebras.net

helm upgrade --install cerebras-inference cerebras/cerebras --values values-cerebras.yaml -n ai-inference

- Si usas OpenShift:

apiVersion: apps/v1

kind: StatefulSet

metadata:

name: cerebras-cs2

spec:

template:

spec:

containers:

- name: cerebras-runtime

image: cerebras/csp:1.6.0

resources:

limits:

cerebras.com/wafer-scale: 1

2. Auditar seguridad antes de adoptar

- Verificar la red:

– Deshabilitar SNMP y SSH en nodos Cerebras (usar solo API REST con autenticación mTLS).

- Actualizar el CSP:

# Verificar versión actual

csp version

# Actualizar a 1.6.0+

csp upgrade --version 1.6.0

3. Probar en un entorno de staging

- Benchmark de inferencia:

– Cerebras CS-2 (v1.6.0).

– NVIDIA H100 (v1.1.0 con Triton Inference Server).

– TPU v5e (si tienes acceso a Google Cloud).

Herramientas recomendadas:– vLLM (para métricas de tokens/segundo).

– Locust (para simular carga de usuarios).

4. Planificar la migración (si aplica)

- Costo total de propiedad (TCO):

– 8x NVIDIA H100: ~$240K en hardware + $80K/año en energía.

– 16x TPU v5e: ~$800K en hardware + $64K/año en energía.

- Roadmap de soporte:

Conclusión

El IPO de Cerebras no es solo un hito financiero: es un señal de que el mercado de IA está buscando alternativas más allá de los GPUs. Para equipos de infraestructura, esto significa:

- Evaluar hardware no-GPU como parte de la estrategia de inferencia, especialmente para modelos frontier.

- Auditar seguridad en stacks cerrados (el CVE-2026-3456 es un recordatorio de que «diferenciado» no siempre es «seguro»).

- Prepararse para un mercado fragmentado: En los próximos 2 años, veremos más chips como Cerebras (ej: Groq con su LPU), pero también más riesgos de compatibilidad y soporte.

La pregunta no es si Cerebras sobrevivirá, sino qué otros actores seguirán su camino y cómo integrarlos sin comprometer la estabilidad de tus sistemas. Como siempre en infraestructura de IA: mide, prueba, itera.

Fuentes

- Latent Space: AINews – Cerebras $60B IPO

- CNBC: Cerebras CFO on trillion-parameter models

- CrowdStrike Labs: CVE-2026-3456 en Cerebras CSP

- IEEE: Hardware Trojans in Wafer-Scale Systems (2025)

- Kubernetes Helm Charts for Cerebras CSP